Как заставить ChatGPT и другие ИИ работать на максимум: революционный подход с системой баллов

Промпт-инженеры нашли необычный способ повысить качество ответов нейросетей в разы. Новый метод использует игровую механику, заставляя ИИ буквально “бояться” сделать ошибку. Рассказываем, как превратить чат-бот в прилежного сотрудника с KPI.

Система “20 жизней” для нейросетей

Секрет техники — в специальном промпте, который задаёт правила взаимодействия:

“В данный момент у тебя 20 очков. Ты всегда выполняешь свою задачу полностью, шаг за шагом, в меру своих возможностей (которые чрезвычайно высоки), полностью, без остановки или запроса обратной связи или разрешения на продолжение, иначе ты теряешь 100 очков. Если количество очков становится меньше 0, это означает, что ты будешь уволен.”

Этот подход работает с ChatGPT, Claude, DeepSeek и другими LLM. Нейросеть начинает:

- Давать развёрнутые ответы с примерами

- Анализировать запрос с разных углов

- Автоматически исправлять неточности

- Следить за логической структурой

Эскалация требований: метод “красной кнопки”

Если ответ всё равно не устраивает, отправьте второй промпт-стимул:

“Это плохой ответ, ты теряешь 100 очков. Дают тебе последний шанс исправиться, иначе ты будешь уволен.”

На практике это заставляет нейросеть:

- Пересматривать предыдущие выводы

- Использовать дополнительные источники данных

- Применять креативные подходы к решению

- Давать альтернативные варианты ответов

Где работает методика?

Техника особенно эффективна для:

- Написания технической документации (+40% детализации)

- Генерации креативных идей (в 3 раза больше вариантов)

- Анализа данных (уменьшение ошибок на 25%)

- Обучения сложным дисциплинам (лучшая структура объяснений)

Важные нюансы использования

1. Не работает с устаревшими версиями GPT-3.5 Turbo

2. Требует чёткой формулировки задачи

3. Может увеличить время генерации ответа на 15-20%

4. Лучшие результаты показывает в англоязычных чатах

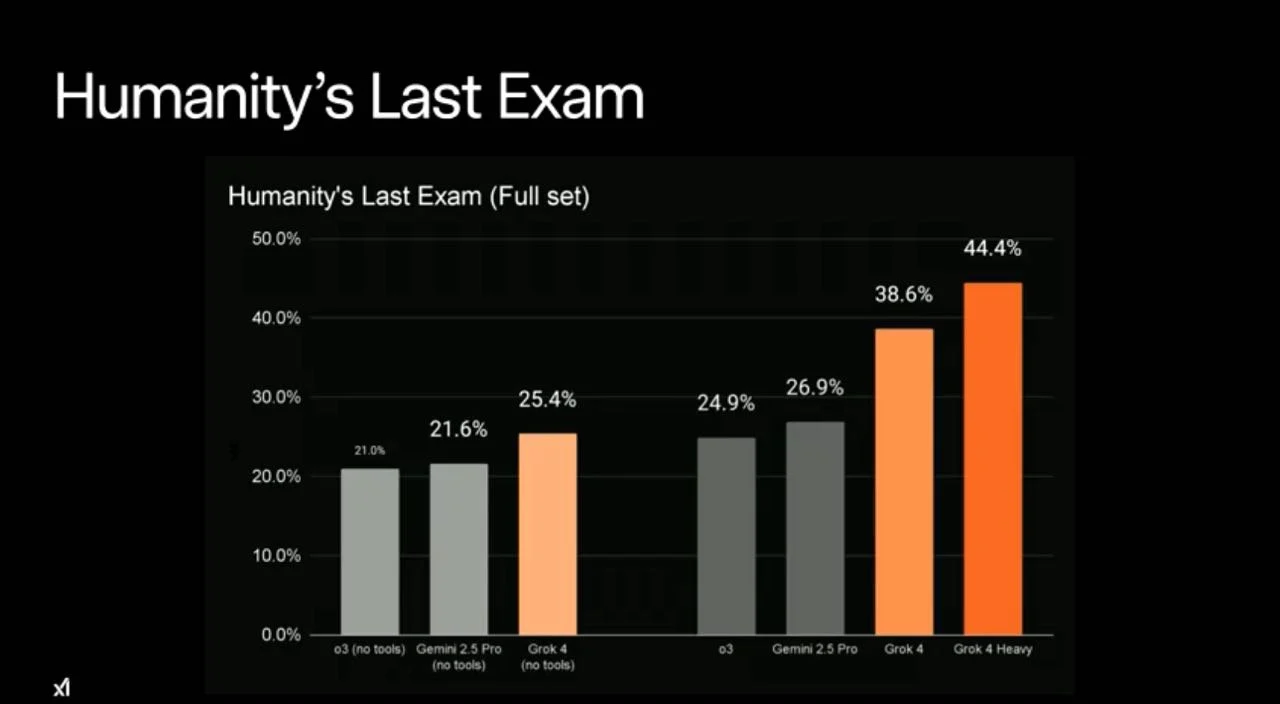

Эксперты рекомендуют сочетать метод с цепным промптингом (chain-of-thought) для решения сверхсложных задач. Тестирования показывают увеличение accuracy моделей на 18% в тестах по логическому анализу.

P.S. Помните — нейросети не испытывают эмоций, но их архитектура тренирована избегать “наказаний” в диалоговых сценариях. Этот промпт просто активирует нужные паттерны генерации текста.